Stanfordo mokslininkai nustatė, kad laikui bėgant GPT-4 tampa vis kvailesnis

įvairenybės / / July 20, 2023

Mokamos ChatGPT versijos tikslumas buvo mažesnis nei nemokamo pokalbių roboto.

Nauja studijuoti Stanfordo universiteto mokslininkai patvirtino, kuo internautai skundžiasi jau kelias savaites: „ChatGPT Plus“, pagrįsta GPT-4 tikrai tapo kvailesnis – skirtingai nei GPT-3.5, kuriame veikia nemokama pokalbių roboto versija.

Savo tyrime autoriai palygino atsakymus į skirtingus pokalbių roboto prašymus, pagrįstus GPT-4 ir GPT-3.5. Jie nustatė, kad pokalbių roboto elgesys ir atsakymų į kai kurias užklausas tikslumas naujojoje versijoje yra labai svarbūs pablogėjo.

Autoriai palygino kovo ir sausio mėn. išleistus GPT-4 ir GPT-3.5 kalbų modelius. Jie nustatė, kad per tą laiką GPT-4 tikslumas pastebimai sumažėjo, o GPT-3.5, priešingai, padidėjo.

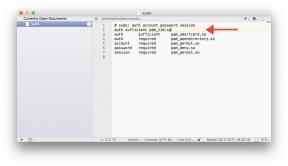

Pavyzdžiui, atsakymo į klausimą, ar 17077 yra pirminis skaičius, tikslumas sumažėjo 95,2%, o GPT-3,5, priešingai, padidėjo nuo 7,4% iki 86,8%. Taip pat dabartinėse abiejų modelių versijose sumažėjo tikimybė sėkmingai įvykdyti neuroninio tinklo parašytą kodą.

Anksčiau OpenAI viceprezidentas Peteris Welinderis jau tai padarė

atsakė į ChatGPT Plus vartotojų kaltinimus:Ne, mes nepadarėme GPT-4 kvailesnio. Viskas yra visiškai priešingai: kiekvieną naują versiją darome išmanesnę nei ankstesnė.

Dabar turime tokią hipotezę: kai ką nors naudojate aktyviau, pradedate pastebėti problemas, kurių anksčiau nematėte.

Piteris Welinderis

„OpenAI“ produkto viceprezidentas

Viename iš atsakymų į šį tviterį Welinderis paklausė pateikti įrodymų, kad pokalbių robotas pablogėjo. Stanfordo mokslininkų atliktas tyrimas pasirodė praėjus 5 dienoms po to – ir OpenAI atsakymo dar negavo.

Tai ne pirmas kartas, kai GPT-4 kaltinamas melagingos informacijos pateikimu. Kovo mėnesį „NewsGuard“ analitikai atradokad GPT-4 pagrindu pagrįstą ChatGPT lengviau meluoti – o pati OpenAI teigia, kad atsakymų tikslumas padidėja 40%, palyginti su GPT-3.5. IN ypač NewsGuard testuose, naujoji neuroninio tinklo versija buvo mažesnė tikimybė paneigti klaidingą informaciją, įskaitant klaidingus duomenis apie šiuolaikinius įvykius ir teorijas. sąmokslus.

Taip pat skaitykite🧐

- 6 ChatGPT analogai

- Jamesas Cameronas apie dirbtinio intelekto pavojus: „Aš jus įspėjau dar 1984 m., bet tu neklausei“

- 8 dirbtinio intelekto mitai, kuriais tiki net programuotojai